OCI Generative AIにおけるエンタープライズAIエージェント

OCI Generative AIのエンタープライズAIエージェントは、本番グレードのエージェント・アプリケーションを構築、実行、デプロイするのに役立つマネージドAPIとホスト・アプリケーションを提供します。

管理対象APIのみ

次の使用可能なコンポーネントを含むAPIコールを介してのみ、インフラストラクチャをデプロイせずにエージェントを構築および実行します。

- エージェントAPI– プロバイダ全体のモデルおよびエージェント機能と対話するためのOpenAI互換のOpen Responses準拠API。

- エージェントツール– ファイル検索、コードインタプリタ、関数呼び出し(ローカルに定義された関数)、MCP呼び出し(リモートMCPサーバー)などのツール機能。

- エージェント・メモリー– 会話API、長期メモリーおよびメモリー・コンテキストの最適化のためのメモリー機能。

- 下位レベルのエージェントのビルディング・ブロック–OpenAI互換のベクトル・ストアAPI、ファイルAPIおよびコンテナAPI。

ホストされているアプリケーション

次のコンポーネントを含むオープンソース・フレームワークを使用して構築されたエージェントをデプロイおよび実行します。

- エージェント・アプリケーション・ホスティング–OpenAI Agents SDK、LangChain、LangGraph、AutoGenなどを使用して構築されたエージェントのデプロイメントおよび自動スケーリング。

- MCPサーバーホスティング–MCPサーバーの配備と自動スケーリング。

ハイブリッド・アプローチ

両方のモデルを、Managed APIを介して実行されるワークロードの一部と、ホストされたアプリケーションとしてデプロイされたrestと組み合せます。

ダイアグラム

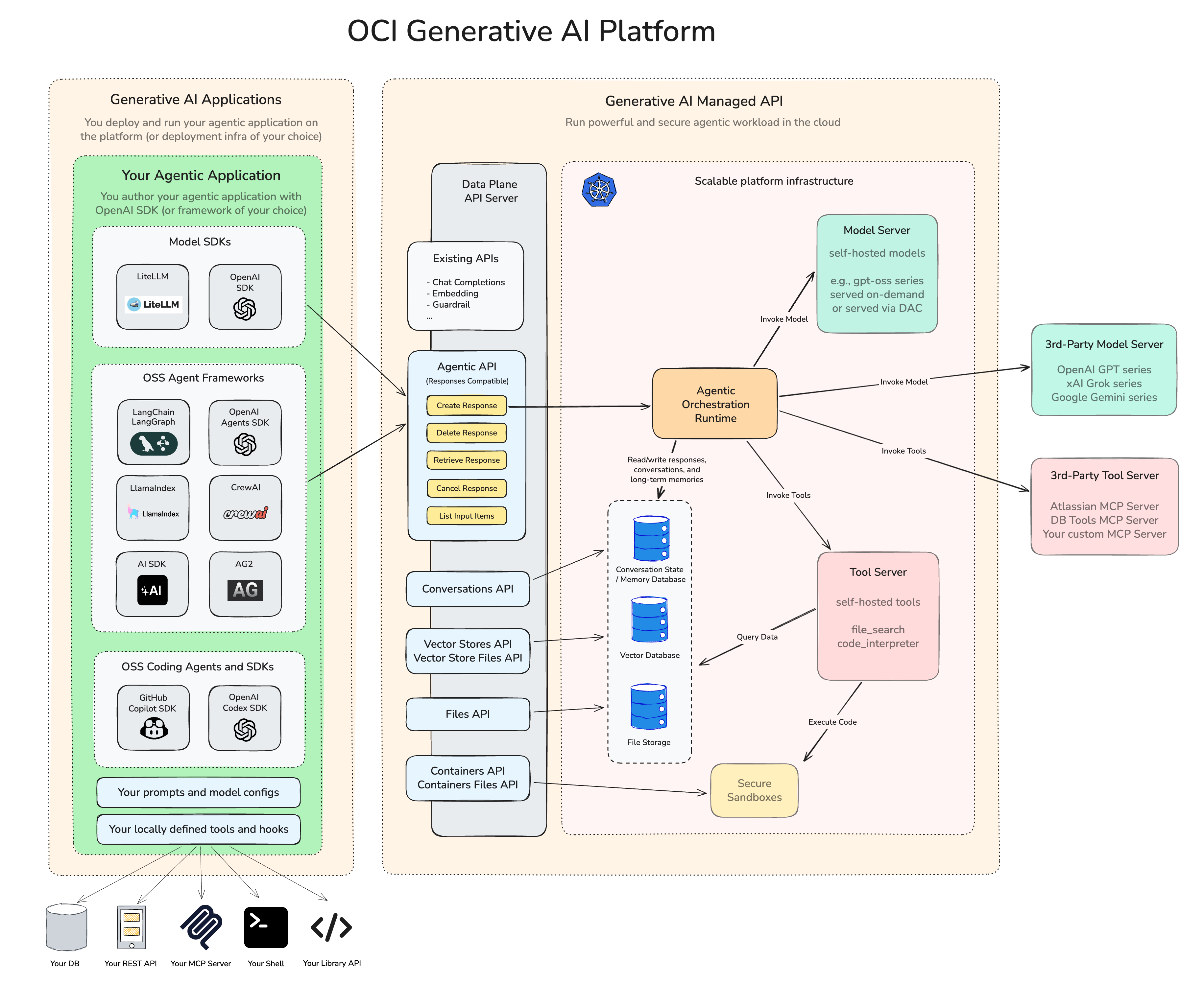

次の図は、OCI Responses APIを使用してエージェントを構築するために使用されるビルディング・ブロックと、OCI Generative AIでエージェント・ワークロードを実行するために使用されるデプロイメント・コンポーネントの両方を示しています。

図の左側には、モデルSDK、エージェント・フレームワーク、プロンプト、モデル構成、およびローカルに定義されたツールとフックを含むエージェント・アプリケーションが示されています。中央には、OCIレスポンスAPI (エージェントAPIとして表示)と関連リソース(エージェント・ツール、メモリー、ファイルAPI、ベクトル・ストアAPI、コンテナAPI、コンテナ・ファイルAPIなど)が表示されます。右側には、スケーラブルなプラットフォーム・インフラストラクチャ、モデル・サーバー、ツール・サーバー、セキュアなサンドボックス、サードパーティ・サービスなど、管理対象ランタイムおよびデプロイメント側のコンポーネントが表示されます。

関連リンク

- IAM権限:

- すべての生成AIリソースへのアクセス権をユーザー・グループに付与します。

- OCIリソースに他のOCIリソースへのアクセス権を付与します。

- エージェント・サポートの認証を設定します。

- OCI GenAI認証パッケージをインストールします。

- エンタープライズAIタスクに必要なOCI生成AIリソースを作成します。

- ベクトル・ストアのタイプに基づいて次のステップを完了します。

- 構造化データの場合は、NL2SQL APIを使用します。

- 非構造化データの場合、データをベクトル・ストアと同期します。